ShipAny Blog

Blog

Read latest product features, solutions, and updates.

comfyui_layerstyle cv2模块坏了修复

comfyui报错cv2,因为import cv2 能导入 但 cv2.__file__ 是 None,或者显示成 namespace

hostinger性能太垃圾了

买了2年,450刀左右,退款了,4cpu一个网站就差不多100%

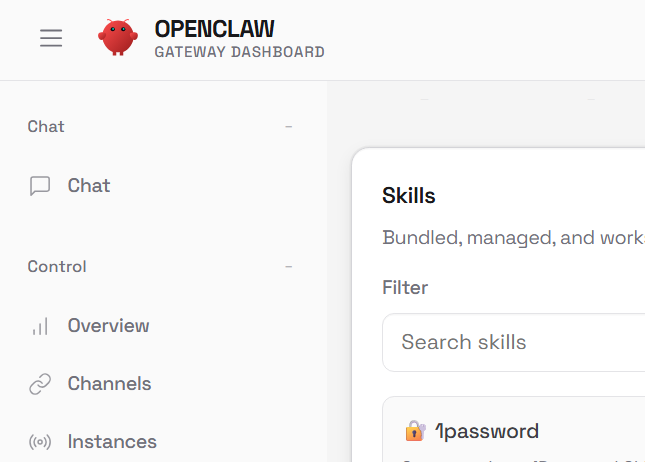

建了个Openclaw的群和知识星球

建了个Openclaw的群和知识星球

温哥华上门安装部署Openclaw服务

温哥华上门安装部署Openclaw服务

Mac mini M4 Pro(64 GB)部署 OpenClaw

Mac mini M4 Pro(64 GB)部署 OpenClaw

测试自动发布

OpenClaw浏览器自动化:自动读取自媒体运营数据

内置浏览器自动化(openclaw profile) vs Relay(chrome profile)

Qwen3.5-397B-A17B火起来了

• 总参数:3970亿(397B) • 激活参数:170亿(17B)— MoE架构,推理时只激活5% • 上下文:百万级别(支持长上下文agent场景)

Pro用户Gemini cli oAuth的额度

Gemini cli oauth free和pro额度区别:Free 用户:每天 1000 requests,限速 60 requests/min Google AI Pro 用户:每天 1500 requests,限速 120 requests/min

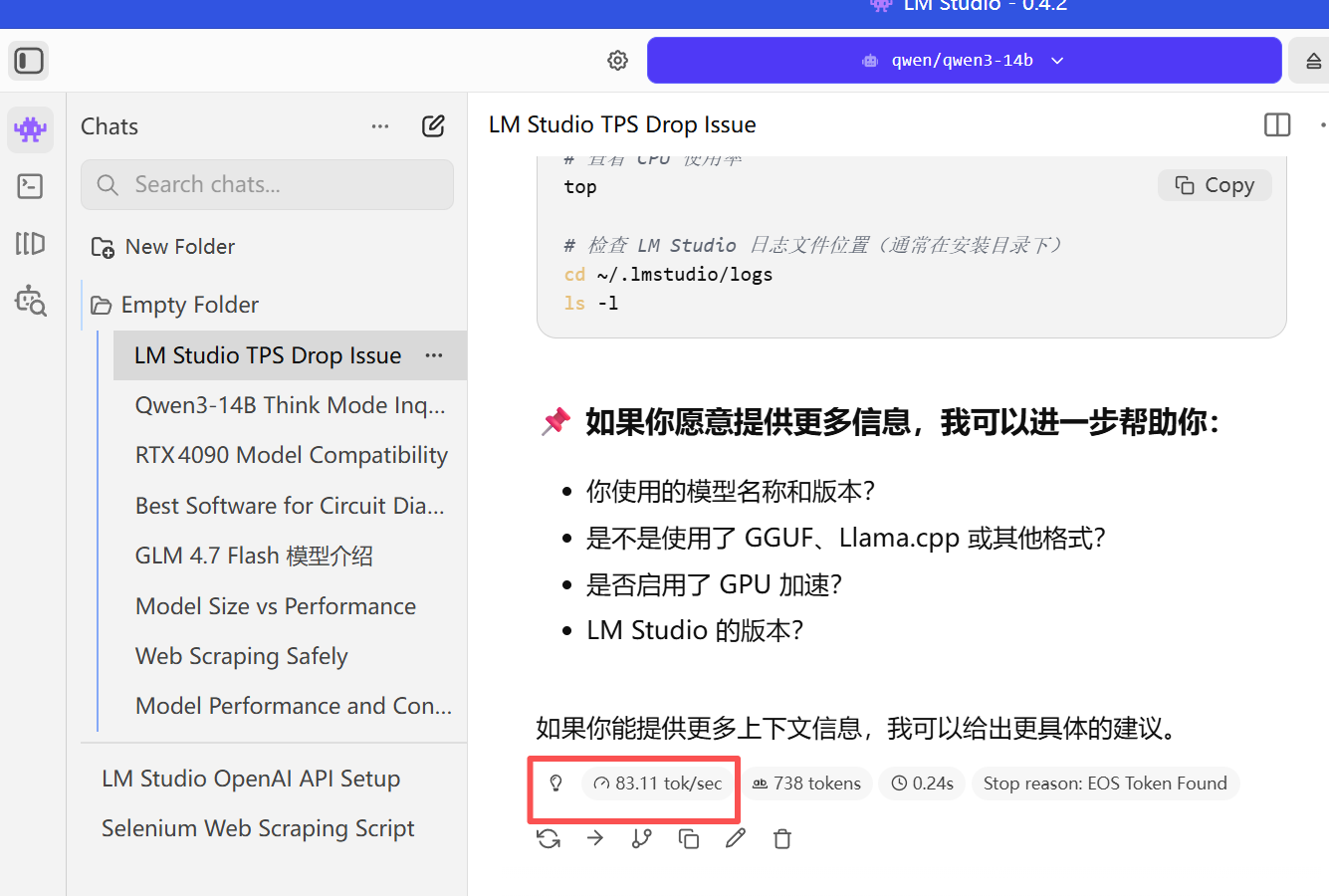

2026年2月截止4090显卡本地最佳模型是这个

我测试了很多模型,发现Qwen3 14B (gguf, Q4_K_M)是最佳的模型

Openclaw和Mac Mini(Studio)是绝配

Openclaw和Mac Mini(Studio)是绝配,就算Win也没太大的意义,一个简单的关显示器,Win是要写个脚本来运行,而Mac只需要一个命令

Tool vs Skill 认知笔记

可以把 Tool 想成一段真正的代码工具,负责执行实际的流程。 而 Skill 更像在教 AI 怎么“理解”和“说话”,通过提示词来引导智能体做决策。

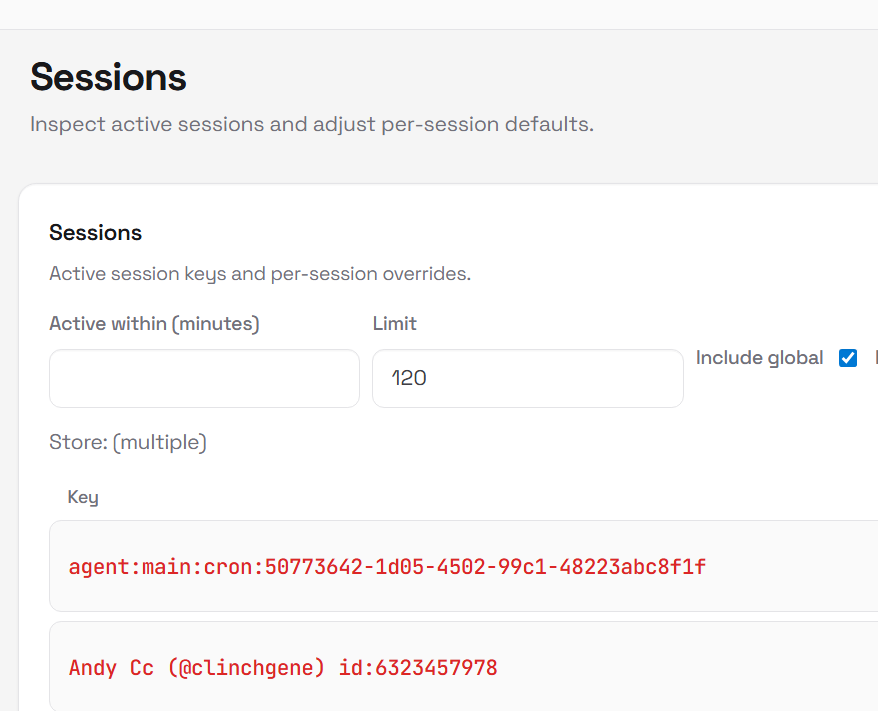

OpenClaw 一轮回答的上下文组成(易懂版)

- 每次模型回答时,用的是: 『基础注入(开局一次) + 本轮工具/命令结果(如 memory_search 命中的片段) + 当前会话的对话上下文』

openclaw 记忆的顺序和作用机制

花了很多时间研究的openclaw memory的顺序和作用机制

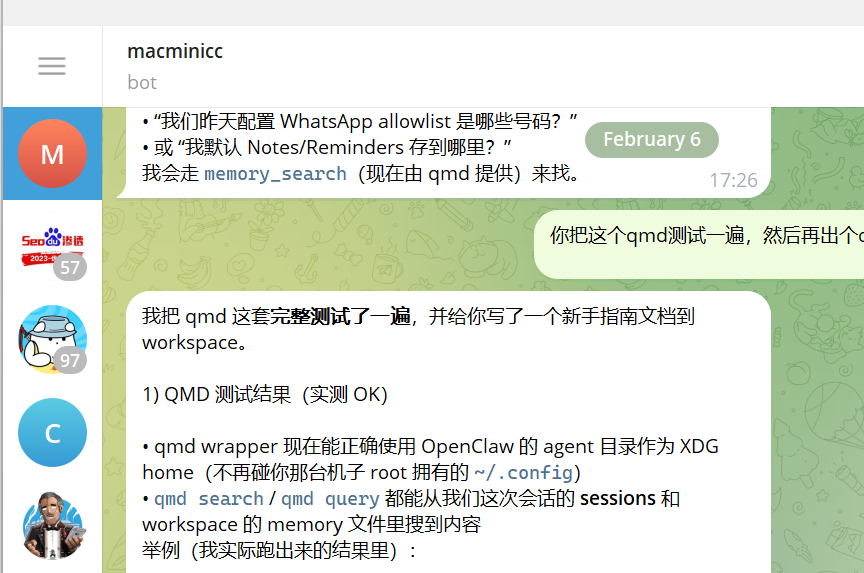

OpenClaw QMD新手安装/配置指南(macOS)

这份指南按 OpenClaw 官网「QMD backend (experimental)」思路整理: - **Markdown 是“记忆源数据”** - **QMD 是本地检索引擎(BM25 + 向量 + rerank)**,用来减少上下文 token(需要记忆时再检索注入) > 适用:macOS(本机自托管 Gateway)。

AI slop 能赚钱,但会被平台与生态反噬

为了流量或平台奖励,用 AI 大规模生产的“看似有用、实则空洞”的内容垃圾

用agent抓X/Reddit热点:本质是需求雷达

用agent抓X/Reddit热点:本质是“需求雷达”

AI最稳的赚钱套路:用agent降成本,把信息/意图卖出去

AI最稳的赚钱套路:用agent降成本,把信息/意图卖出去

Win下OpenClaw 安装教程

总结下win下安装OpenClaw和配置的过程

GCloud CLI对网站的用处是什么?

GCloud CLI把你在 GCP 上的所有东西,用命令行做成可复制、可自动化的流程(部署、扩容、备份、监控、成本控制、权限管理)。

微信等国内生态接入AI对我用处不大

处于某些原因,人在海外就尽量不要用国内生态,而且目前业务和国内无关

Moltbot+Codex = 省钱的AI员工

Codex是Openai的ChatGPT OAuth,订阅就可以免费使用Moltbot,所以省钱啊!

Moltbot + Notion 做 GTD:流程与注意点

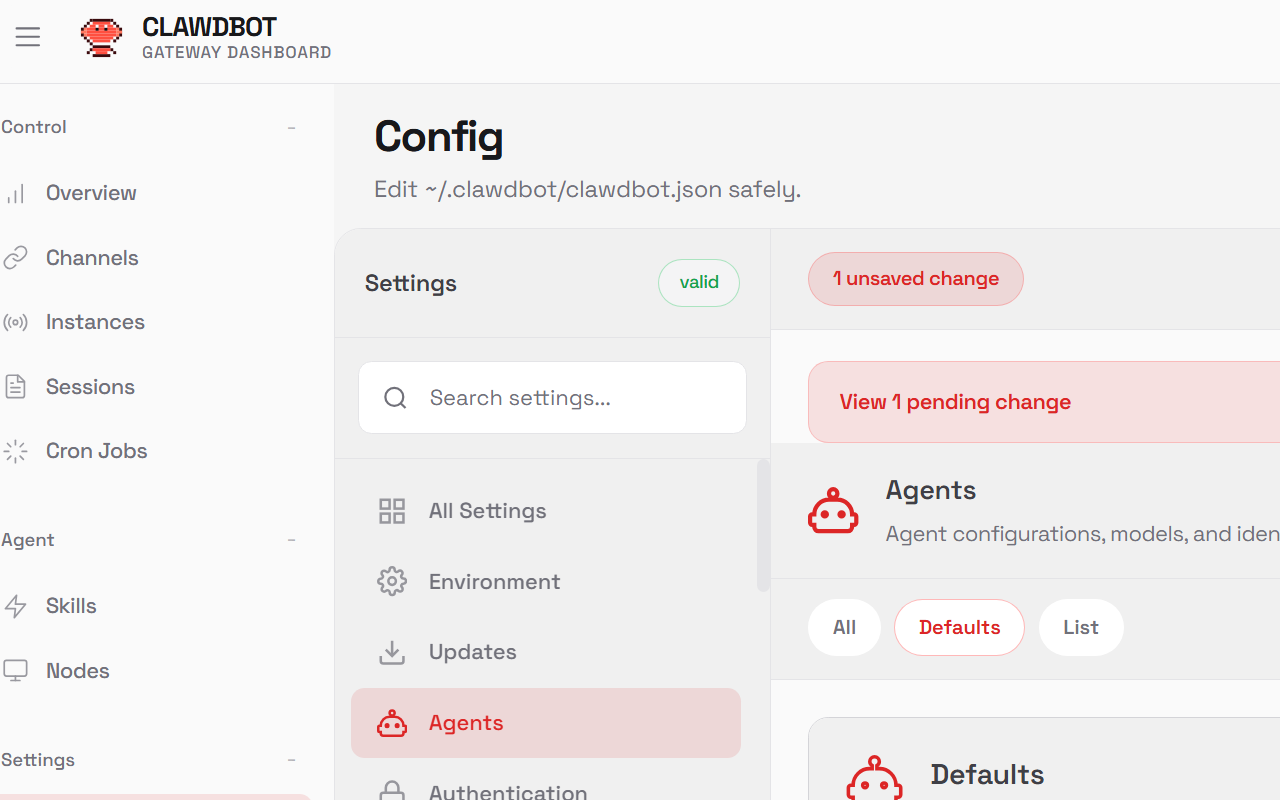

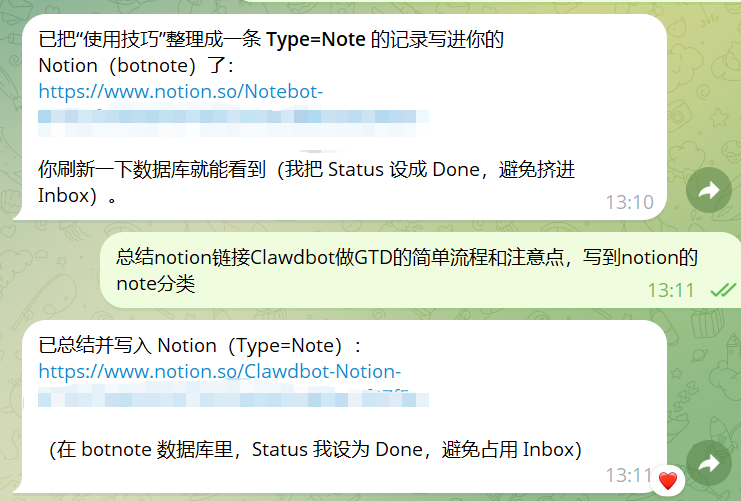

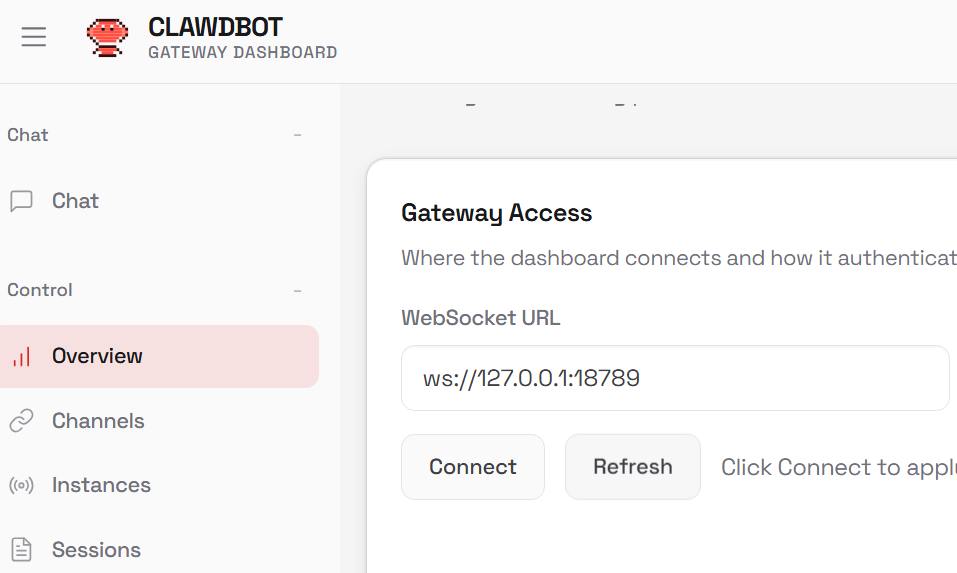

走通了Moltbot(Clawdbot)+ Notion 做笔记的配置,写个日志

Moltbot使用报告

Moltbot(也就是Clawdbot)使用报告

Z-image base评价

base模型完全不可玩,肢体不行,美学不行,nsfw太可怕了,速度非常慢 5090 30s一张1.5k

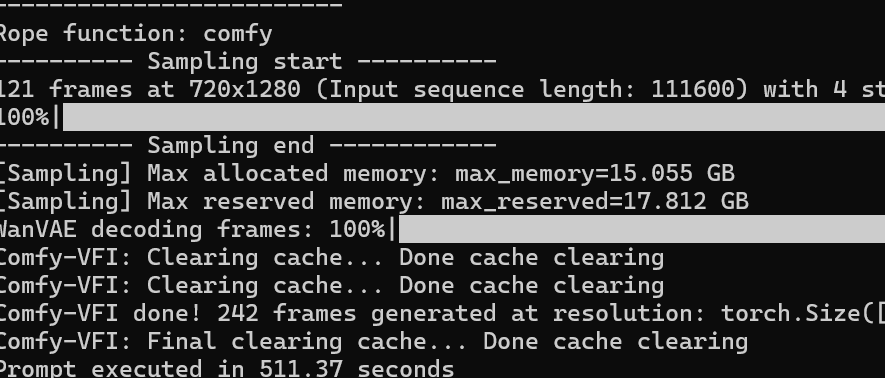

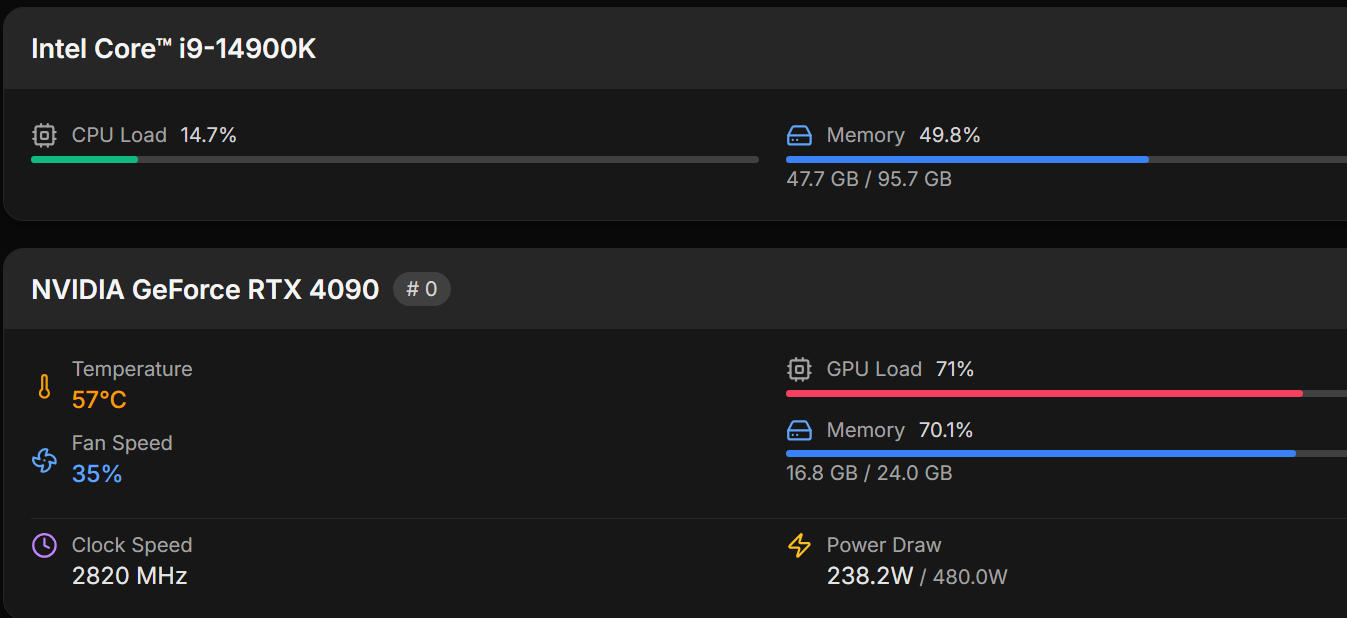

Wan2.2 lora训练爆OOM了

Wan2.2 lora训练爆OOM了,白费了一个晚上

测试ltx-2 Lora效果结论

如果追求最终成片质量与稳定性,Wan2.2 仍然更适合作为主力;LTX-2 更适合作为“快速迭代/预演/口播类内容”的补充工具。

AI-Toolkit训练ltx-2 Lora笔记

实操的AI-Toolkit训练ltx-2 Lora笔记,从部署到参数到注意点

LTX2 lora训练还是有必要的,因为i2v太弱了!

LTX2 lora训练还是有必要的,因为i2v功能太弱了,出来的图片比较崩!

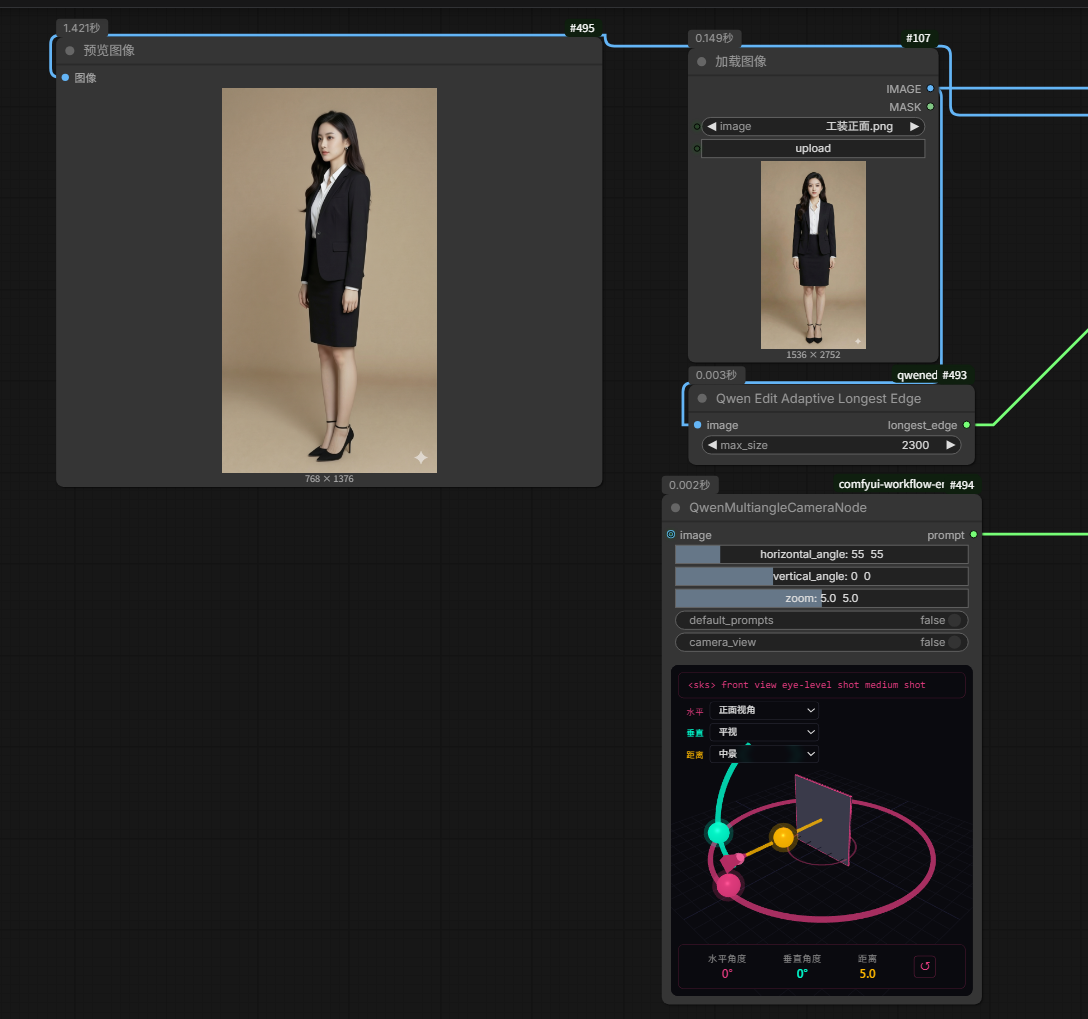

可视化视角改变编辑工作流笔记(分镜辅助)

工作流处理图片场景和人物的多角度lora,可实现分镜功能

About Me

I’m Chen Lincai, an IT developer. I build and maintain websites, automate workflows with AI agents, create ComfyUI pipelines, and handle server deployment & operations.